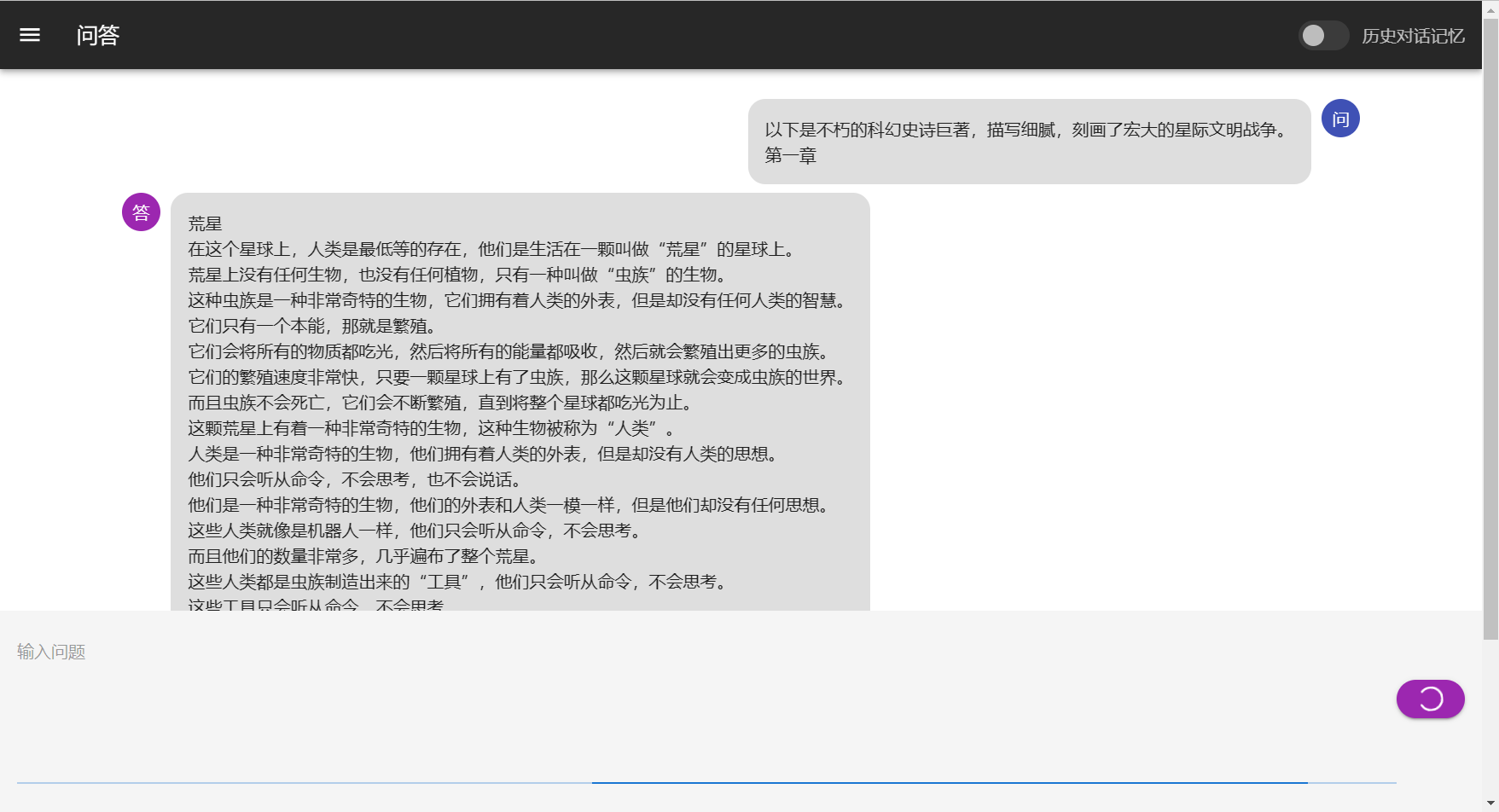

闻达:一个大型语言模型调用平台

简介

- 目前支持模型:chatGLM-6B、chatRWKV、chatYuan。

- 在chatGLM-6B模型实现类chatPDF功能

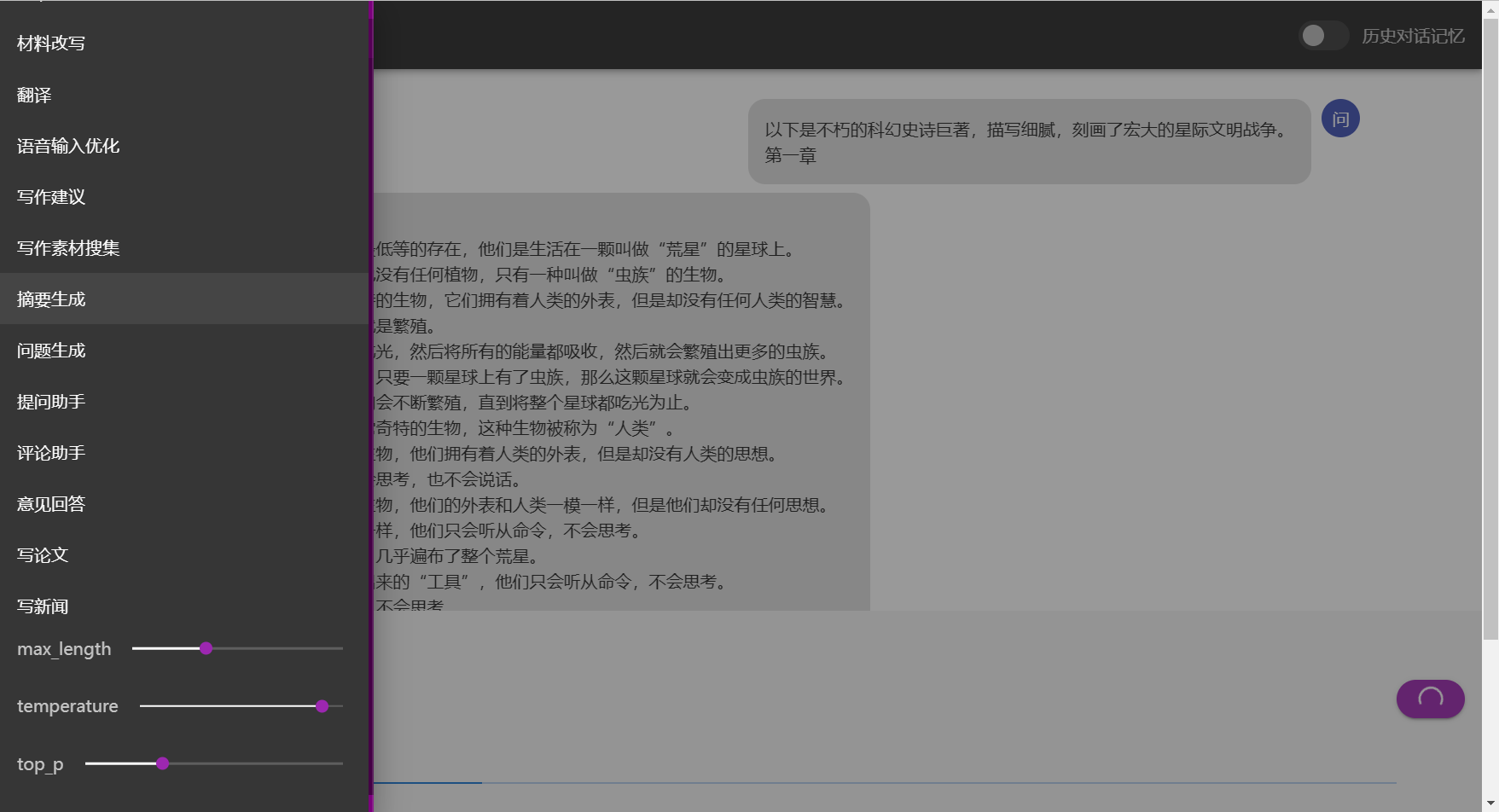

- 支持参数在线调整

- 支持chatGLM-6B流式输出和输出过程中中断

- 自动保存对话历史至浏览器(多用户同时使用不会冲突)

- 删除单条对话历史

- 支持局域网、内网部署和多用户同时使用。(内网部署需手动将前段静态资源切换成本地)

- 多用户同时使用中会自动排队,并显示当前用户。

懒人包

链接:https://pan.baidu.com/s/105nOsldGt5mEPoT2np1ZoA?pwd=lyqz 提取码:lyqz 包含程序主体和chatGLM-6B、chatYuan,分部是独立的压缩文件。chatRWKV模型更新频繁,请去官方链接下最新的。 目前的懒人包,不支持chatPDF功能

安装

1.安装库

paste

sqlalchemy

sqlalchemy_utils

2.日志功能

打开功能,需要打开相应模型API文件,改第六行logging=False为logging=True。

chatPDF功能(在chatGLM-6B模型实现)

准备

1.下载中文sentence transformers模型

下载simcse-chinese-roberta-wwm-ext,放在sentence-transformers\simcse-chinese-roberta-wwm-ext。

2.索引语料

把自己的txt格式的文档放在名为txt的文件夹里,运行gen_data.py。 完整安装requirements.txt

使用

正常使用中,勾选右上角chatPDF

chatGLM-6B

GLM6BAPI.py 模型默认位置:model\chatglm-6b-int4

chatRWKV

rwkvAPI.py 模型默认位置:RWKV-4-Pile-7B-EngChn-testNovel-2119-ctx2048-20230313.pth

chatYuan

YuanAPI.py 模型默认位置:ChatYuan-large-v2